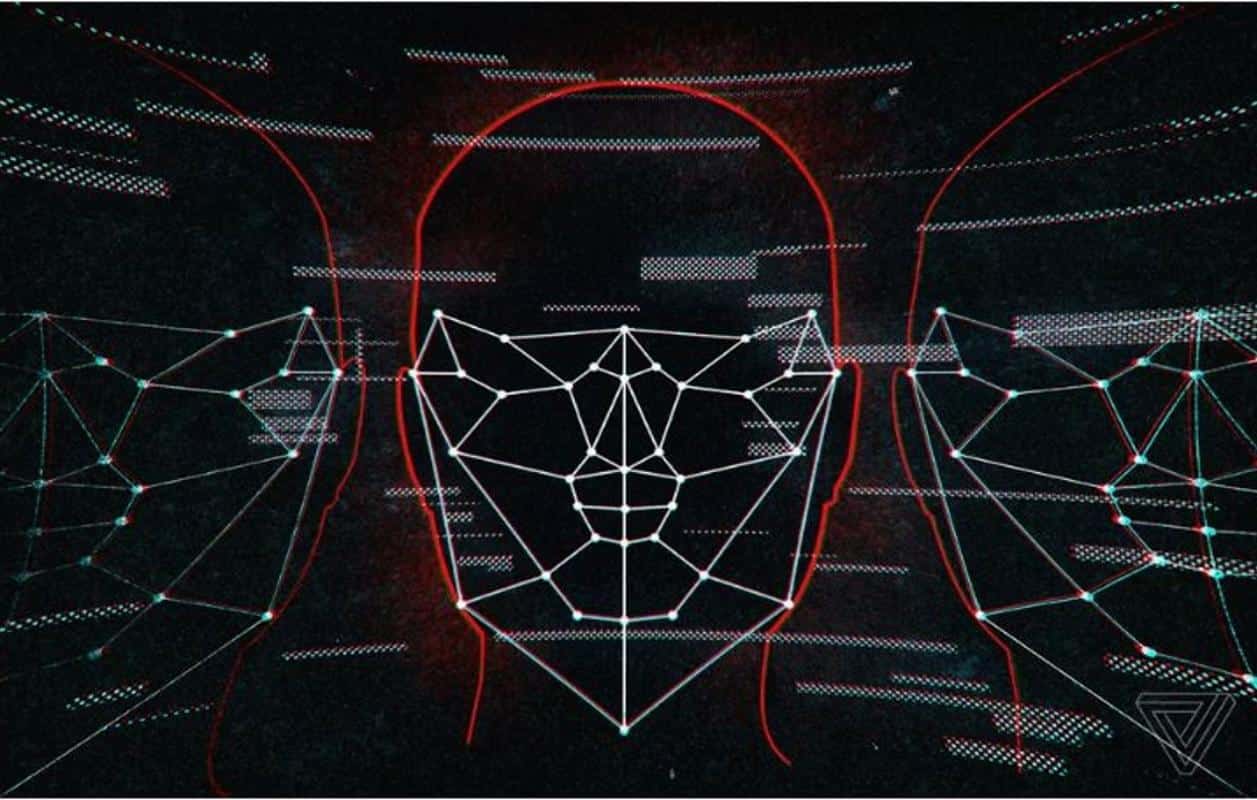

Um dos grandes desafios da Inteligência Artificial atualmente é aprimorar o sistema de reconhecimento facial. Mas, na contramão desse projeto, a Traces AI, uma startup de visão computacional, está focada em criar câmeras para rastrear pessoas sem depender de dados de reconhecimento facial, algo que, segundo os fundadores, é invasivo demais à privacidade do público.

A nova tecnologia desfoca todos os rostos humanos do quadro e analisa os elementos restantes. “É uma combinação de diferentes elementos visuais. Podemos usar seu estilo de cabelo, uma mochila, o tipo de calçado e a combinação da roupa”, explicou a co-fundadora, Veronika Yurchuk.

“A maior preocupação é: ‘Você realmente quer banir a tecnologia que está protegendo as pessoas hoje, e que protegerá o país no futuro?’ É difícil argumentar, mas o que estamos realmente tentando fazer é propor uma alternativa eficaz, mas menos invasiva”, disse a co-fundador, Kostya Shysh.

O portal Tech Crunch questionou a viabilidade de um projeto como esse em ruas movimentadas da cidade, onde criminosos podem simplesmente trocar a jaqueta e colocar um boné. Mas para a Traces AI, a tecnologia pode ser a melhor opção para lugares fechados, que possui dados limitados sobre pessoas em suas instalações.

A startup citou o exemplo de encontrar uma criança perdida no parque de diversões com apenas alguns dados. “Você pode dar uma descrição verbal como ‘é um menino de dez anos desaparecido, ele está com uma bermuda azul e uma camiseta branca’, isso será informação suficiente para começarmos uma busca’, afirmou Shysh.

Além disso, segundo a empresa, sua tecnologia pode ajudar a reduzir o viés racial desses sistemas de visão computacional, que são mais propensos a apresentar ‘falsos-positivos’ no caso de pessoas negras.

“Nós desfocamos o rosto das pessoas antes de enviar para a nuvem. Estamos fazendo isso intencionalmente como um dos mecanismos de segurança para não gerar preconceitos raciais e de gênero”, declara Shysh.

Fonte: Tech Crunch