Pesquisadores mostraram novos softwares que usam aprendizado de máquina e permitem que qualquer pessoa possa editar a transcrição de texto de um vídeo para adicionar, excluir ou alterar as palavras que saem diretamente da boca do alvo em questão.

Os cientistas da Universidade de Stanford, do Instituto Max Planck de Informática, da Universidade de Princeton e da Adobe Research, mostraram que a capacidade de editar o que as pessoas dizem em vídeos e criar falsificações realistas está se tornando mais fácil a cada dia.

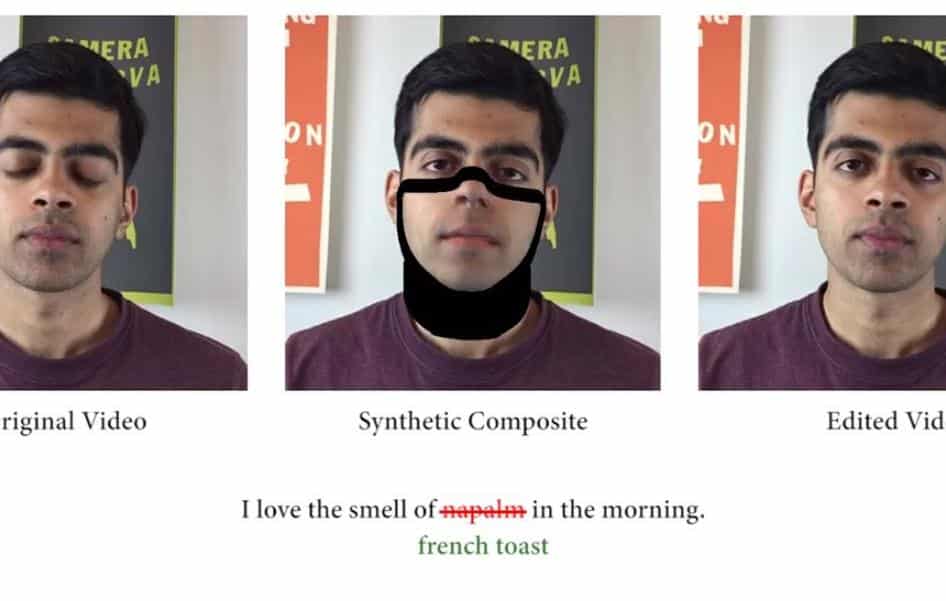

Para criar as falsificações, o vídeo passa por diversas técnicas. Primeiramente, o material original é escaneado para isolar fonemas, que são, depois, combinados com as expressões faciais de cada som. E, finalmente, o modelo 3D da metade inferior do rosto da pessoa é criado.

Quando alguém edita uma transcrição de texto do vídeo, o software combina todos esses dados coletados – os fonemas, os sons e o modelo de face 3D – para construir novas imagens que correspondam à entrada de texto. Isso é então colado no vídeo de origem para criar o resultado final.

Nos testes em que os vídeos falsos foram exibidos para um grupo de 138 voluntários, cerca de 60% dos participantes disseram que as edições eram reais. Isso pode parecer muito baixo, mas apenas 80% desse mesmo grupo achava que a gravação original era legítima. Este resultado pode ter sido influenciado pelo fato de que os entrevistados foram alertados de que se tratava de um estudo sobre edição de vídeos, portanto, buscaram por falsificações.

Existem, porém, algumas restrições para o funcionamento deste tipo de plataforma. Os algoritmos aqui só funcionam em vídeos em que o objeto aparece com foco no rosto, por exemplo, e exigem 40 minutos de dados de entrada. O discurso editado também não parece ser muito diferente do material original, e em suas falsificações de melhor qualidade, os pesquisadores pediram aos participantes que gravassem um novo áudio para combinar com as mudanças, usando Inteligência Artificial (AI) para gerar o vídeo.

Os cientistas também observam que ainda não é possível mudar o humor ou tom da voz dos falantes, pois isso levaria a “resultados surpreendentes”.

Mas, considerando que a pesquisa está nos estágios iniciais, os resultados foram bastante inusitados. Igual qualquer tecnologia deepfake, ela possui consequências perigosas se utilizada de forma mal-intencionada. Os pesquisadores dizem que pensaram sobre essas consequências e oferecem uma solução – embora essa não seja muito reconfortante.

Eles dizem que para evitar confusão, o vídeo editado por IA deve ser claramente apresentado como tal, seja pelo uso da marca d’água ou pelo contexto. Mas as marcas d’água são de fácil remoção e a perda de contexto é uma das marcas da mídia online. DeepFakes não precisam ser perfeitos para causar impacto também. Muitos artigos de notícias falsas podem ser facilmente desmascarados com a pesquisa de alguns minutos, mas isso não impede sua disseminação.

Os pesquisadores observam que tecnologias como essa também têm muitos usos benéficos. Seria de grande ajuda para os setores de cinema e TV, permitindo que estes consertassem as linhas erradas sem regravar as filmagens e criassem dublês de atores capazes de falar diferentes idiomas. Mas esses benefícios parecem pequenos do que os possíveis danos.

Via: The Verge